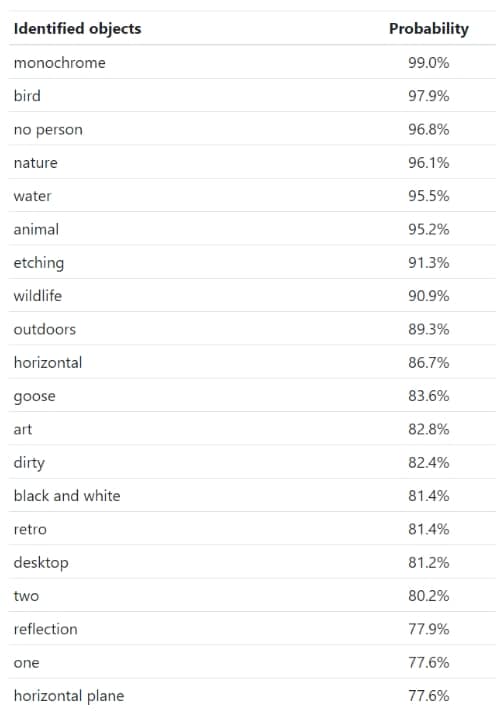

Voor een artistiek project had ik afbeeldingen nodig van uitgekauwde kauwgums. Ik wist dat de zoekmachine Bing een handige feature ‘Image Search Widget’ had, waarmee je een plaatje kunt uploaden en vervolgens een lijst met vergelijkbare afbeeldingen als resultaat terugkrijgt. Ik bood Bing een afbeelding met een kauwgum die ik op straat had gefotografeerd, maar tot mijn verbazing kwam dit Image Recognition- model met geen enkele afbeelding terug waarop een kauwgum stond. Wel werden er allerlei andere voorwerpen tevoorschijn getoverd zoals wormpjes, schelpen, hangertjes, witte bloempjes, kapotte eieren en pingpongballen:

Wat ik in feite te zien kreeg is de bias – ongewenste systematische afwijkingen in de resultaten van het model. Bing is niet getraind op dit soort amorfe objecten. Het kan niet meer dan het aanbieden van afbeeldingen die met een bepaalde mate van waarschijnlijkheid het dichtst bij het aangeboden plaatje liggen.

Het vertekend beeld

Bias heeft een negatieve connotatie en dat is voor een groot deel terecht. Steeds meer bedrijven en maatschappelijke organisaties maken gebruik van AI-technologie in hun serviceverlening en de internetgebruikers krijgen steeds meer apps aangereikt om er mee aan de slag te gaan. Nog te vaak wordt haast blindelings vertrouwd op de beslissingen of voorspellingen die AI-modellen verschaffen, terwijl de algoritmen gebaseerd zijn op statistische berekeningen en de uitkomsten slechts een bepaalde mate van waarschijnlijkheid hebben. Dankzij de nieuwe taalmodellen (zoals chatGPT) ogen de uitkomsten ook nog steeds geloofwaardiger. De gebruiker heeft te weinig notie dat deze AI-modellen weleens slecht of onvoldoende getraind kunnen zijn en daardoor desinformatie verspreiden of nog erger bevooroordeeld zijn en onrechtvaardige beslissingen nemen.

Bias is inherent aan AI-modellen en verschaft ons in principe een vertekend beeld. Het is zaak om kritisch te blijven op de uitkomsten van AI-modellen. Het herkennen van de bias en deze goed onder de loep te nemen, helpt ons de AI-modellen betrouwbaarder te maken en de desinformatie te verkleinen.

Onverwachte voorspellingen

Over het algemeen wordt een AI-model beschouwd als een black box, omdat het niet meteen duidelijk is hoe het model tot zijn voorspellingen of beslissingen is gekomen. Dit geldt vooral voor complexe modellen, zoals diepe neurale netwerken, die miljoenen parameters en lagen kunnen hebben die moeilijk te interpreteren zijn.

Toch is het mogelijk om inzicht te krijgen in hoe een AI-model werkt, door het input-output gedrag te analyseren. Als voorbeeld kom ik terug op het experiment met het kauwgumpje. Als we nog eens naar de resultaten kijken en deze naast elkaar leggen, dan zien we een patroon: allen vertonen een klein wit object tegen een donkergrijze achtergrond. Wat blijkt, is dat Bings model slechts gebaseerd is op algoritmen die op pixelniveau opereren. Het vergelijkt alleen de mimetype, kleur en transparantie van de afbeeldingen in haar database.

Datavisualisatie is een van de methodes die kan helpen bij het verminderen van bias. De methodes zijn:

- Identificeren van patronen: door data te visualiseren, kunnen patronen in de data worden geïdentificeerd die anders misschien niet zo duidelijk zouden zijn. Dit kan helpen bij het opsporen van mogelijke bias of onverwachte trends in de data.

- Identificeren van uitschieters: datavisualisatie kan helpen bij het identificeren van uitschieters of extreme waarden in de data, die mogelijk invloed hebben op de analyse en interpretatie van de resultaten.

- Inzicht in de data: datavisualisatie kan helpen bij het bieden van een visueel inzicht in de data, waardoor gebruikers de gegevens beter kunnen begrijpen en interpreteren.

- Vergelijkingen maken: met behulp van datavisualisatie kunnen verschillende datasets gemakkelijker met elkaar worden vergeleken, waardoor mogelijke bias in een dataset kunnen worden geïdentificeerd.

- Identificeren van inconsistenties: door data te visualiseren, kunnen inconsistenties in de data worden geïdentificeerd die anders over het hoofd zouden worden gezien. Dit kan helpen bij het opsporen van mogelijke fouten of problemen met de data.

Onderzoek naar de bias kan tevens leiden tot nieuwe inzichten en creativiteit. Zouden we als een ontwerper naar het kauwgumpje kijken om te bezien welke vormen we, bij wijze van spreken, ermee zouden kneden, dan oogt het alsof Bing met suggesties komt. De statistische waarschijnlijkheden van de afbeeldingen lijken zich te vertalen naar mogelijkheden.

AI heeft inmiddels haar intrede gedaan in de creatieve sector. Vera van der Burg is een designer die bij vormonderzoek gebruik maakt van AI-modellen, deze manipuleert en de bias gebruikt voor nieuwe ontwerpen.

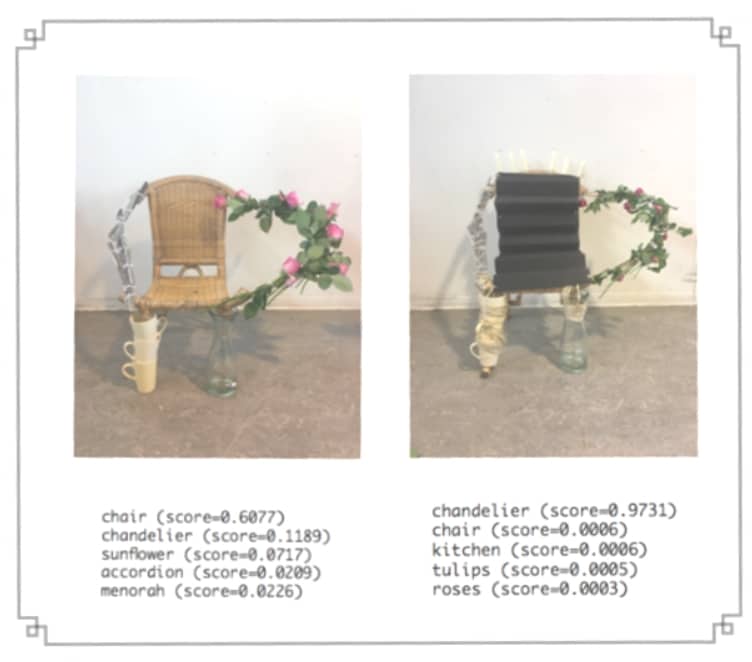

Een van haar eerste experimenten met een Image Recognition model was een dialoog die ze met het model, die ze Algo noemde, voerde. Ze bood in eerste instantie een afbeelding van een normale stoel aan, waarop het Algo terugkwam met een lijst van objecten zoals het model de afbeelding interpreteerde. De ‘stoel’ stond weliswaar hoog in de ranking, maar het AI-model zag ook allerlei andere voorwerpen in de ‘stoel’. Van der Burg gebruikte die bias vervolgens om de oorspronkelijke stoel aan te passen. Van het herontwerp maakte Van der Burg een foto en bood deze opnieuw aan het model. Deze iteratie voerde ze een aantal keren uit, zie de afbeeldingen hieronder. De bias leidde tot onorthodoxe nieuwe ontwerpen van de stoel.

De schoonheid van Bias

Bias is niet iets waar we zo snel mogelijk vanaf moeten komen of negeren, maar juist gebruik kan worden om het AI-model op zijn merites te beoordelen. Het mooie van bias is dat het nieuwe inzichten kan verschaffen en de creatieve geest kan prikkelen.

Uit: ‘The Incredible story of ALGO AND I’ van Vera van der Burg

Interessant voor jou?

Etesian wil graag in contact treden met ontwerpbureaus en bedrijven in de creatieve sector om de mogelijkheden van deze nieuwe AI-technologie voor hun bedrijfsvoering af te tasten.

Is je interesse gewekt? Neem dan contact met ons op: